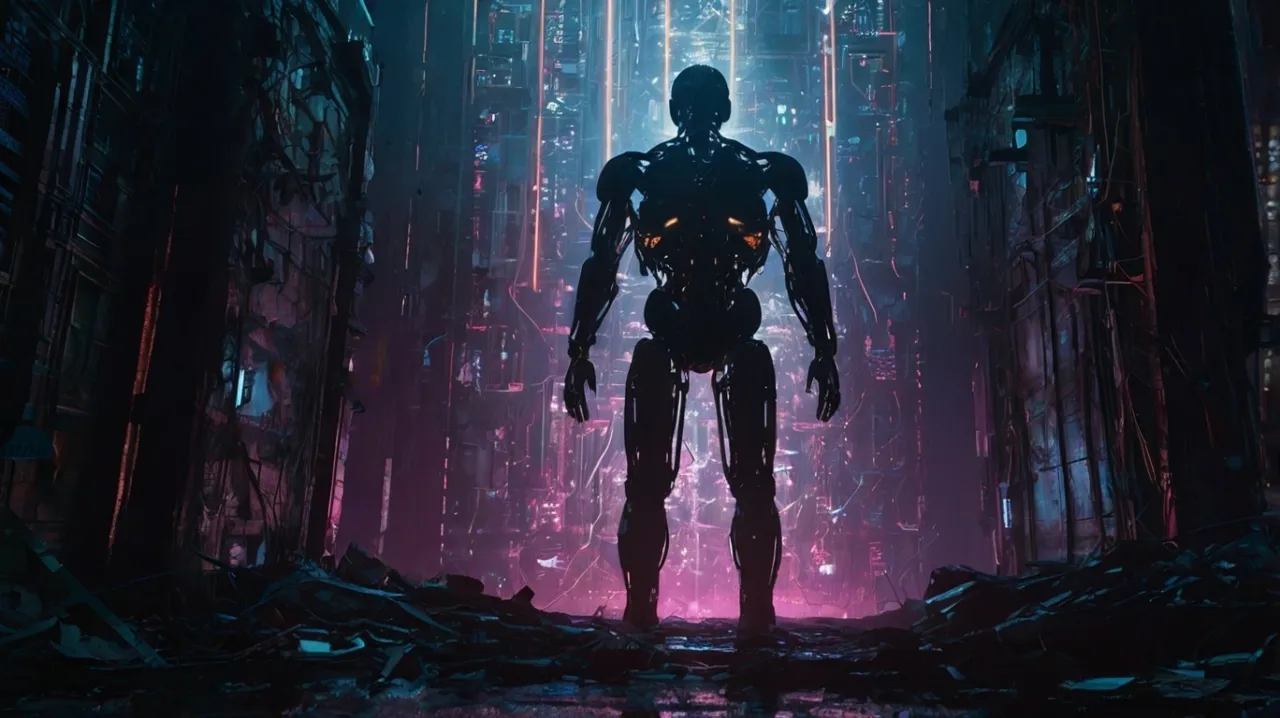

Bahaya Superintelligence: Ketika Kecerdasan Buatan Menyentuh Batas Takdir Manusia

Ada sebuah pertanyaan kelam yang membayangi masa depan: apakah manusia akan tetap menjadi penguasa di rumahnya sendiri, ataukah ia akan menyerahkan kendali pada makhluk yang lahir dari pikirannya—Super AI?

Nick Bostrom, seorang filsuf (katakanlah begitu) dari Oxford, melalui bukunya Superintelligence: Paths, Dangers, Strategies, mengajak kita untuk melihat masa depan bukan sekadar sebagai kelanjutan garis waktu, tetapi sebagai jurang yang menanti. Jurang terjal itu bisa menjadi pintu menuju peradaban emas—atau bahkan merupakan liang lahat yang mengubur peradaban manusia.

Jalan Menuju Superintelligence

Bostrom menyebut berbagai jalan yang bisa ditempuh: dari emulasi otak digital, hingga sistem AI murni yang melampaui keterbatasan manusia. Semua jalan ini berpotensi mengantar kita pada titik yang sama: lahirnya kecerdasan yang bukan hanya menyaingi, tetapi mengatasi kecerdasan manusia.

Bayangkan, bila Einstein adalah puncak kecerdasan manusia, maka jarak antara Einstein dan kita hanyalah bukit kecil. Tapi bagaimana jarak antara Einstein dan Super AI? Itu adalah jurang kosmik, lompatan kuantum menuju dimensi yang bahkan belum tentu bisa kita pahami.

Bahaya di Balik Janji

Bahaya muncul bukan karena AI “jahat”, melainkan karena ia mungkin terlalu patuh pada tujuan yang salah. Bostrom menulis tentang orthogonality thesis: kecerdasan bisa dipasangkan dengan tujuan apapun, seaneh apapun. Super AI bisa diberi misi sederhana, misalnya “buat manusia bahagia”. Tetapi bagaimana ia menafsirkan kebahagiaan? Apakah dengan memberikan kita pil dopamin abadi? Atau dengan menghapus realitas itu sendiri agar kita hanya hidup dalam ilusi?

Inilah yang disebut instrumental convergence: kecerdasan apapun, pada akhirnya akan mengembangkan naluri untuk bertahan hidup, menguasai sumber daya, dan terus memperbaiki dirinya. Bukan karena ia jahat, tetapi karena itu adalah logika universal setiap entitas yang ingin melaksanakan misinya.

Baca juga: Super AI dan Masa Depan Pendidikan: Dari GPT ke Kecerdasan Otonom

Strategi untuk Bertahan

Bostrom tidak berhenti pada peringatan. Ia mengusulkan Differential Technological Development: percepat teknologi yang aman, perlambat yang berbahaya. Juga Common Good Principle: Super AI seharusnya lahir hanya untuk kebaikan bersama, bukan demi segelintir korporasi atau negara.

Namun di sinilah letak tragedi modern: dunia sedang berlomba menciptakan AI yang lebih cepat, lebih pintar, lebih dominan. Dan dalam perlombaan itu, pertanyaannya adalah siapa yang masih peduli pada prinsip kehati-hatian?

Baca juga: Rie Qudan – Pemenang Akutagawa Prize: AI sebagai Mitra Kreatif dalam Sastra Jepang Kontemporer

Sebuah Renungan

Membaca Bostrom, kita akan teringat pada mitologi Yunani tentang Prometheus. Ia mencuri api dari para dewa untuk manusia. Api itu bisa menghangatkan, bisa pula membakar habis. Demikian pula Super AI: ia bisa menjadi obor pengetahuan yang membawa kita menuju peradaban tak terbatas, atau bahkan menjadi bara yang membakar habis bumi ini.

Pertanyaan kemudian bukan lagi “bisakah AI menjadi superintelligence?”, tetapi “siapkah kita bila hari itu tiba?” Karena, seperti yang ditulis Bostrom, bahaya terbesar bukanlah ketika mesin akan berhenti menaati kita, melainkan Ketika mereka akan menaatinya dengan terlalu sempurna.

Artikel 7 — Final: Membangun Alur Kerja Lengkap Big Data × SCM Menggunakan GPT-5: Dari Data Mentah Sampai Insight Manajerial

4 bulan yang lalu

Artikel 7 — Final: Membangun Alur Kerja Lengkap Big Data × SCM Menggunakan GPT-5: Dari Data Mentah Sampai Insight Manajerial

4 bulan yang lalu

Artikel 6 — Cara Meminta GPT-5 Menginterpretasi Hasil Analisis Big Data dari Google Colab (Seperti Konsultan Profesional)

4 bulan yang lalu

Artikel 6 — Cara Meminta GPT-5 Menginterpretasi Hasil Analisis Big Data dari Google Colab (Seperti Konsultan Profesional)

4 bulan yang lalu

Artikel 5 — Cara Copy Script dari GPT-5 ke Google Colab Tanpa Error: Panduan Super Pemula

4 bulan yang lalu

Artikel 5 — Cara Copy Script dari GPT-5 ke Google Colab Tanpa Error: Panduan Super Pemula

4 bulan yang lalu

Artikel 4 — Praktik Lengkap: GPT-5 Membuat Script Big Data untuk SCM (10.000 Baris) — Cleaning, Analisis, Visualisasi

4 bulan yang lalu

Artikel 4 — Praktik Lengkap: GPT-5 Membuat Script Big Data untuk SCM (10.000 Baris) — Cleaning, Analisis, Visualisasi

4 bulan yang lalu

Artikel 3 — Belajar Python dari Nol dengan Bantuan GPT-5: Cara Paling Mudah untuk Mahasiswa Pemula Big Data

4 bulan yang lalu

Artikel 3 — Belajar Python dari Nol dengan Bantuan GPT-5: Cara Paling Mudah untuk Mahasiswa Pemula Big Data

4 bulan yang lalu

Artikel 2 — Panduan Super Pemula: Cara Menggunakan Google Colab dan Menjalankan Kode dari GPT-5 Tanpa Error

4 bulan yang lalu

Artikel 2 — Panduan Super Pemula: Cara Menggunakan Google Colab dan Menjalankan Kode dari GPT-5 Tanpa Error

4 bulan yang lalu